—-广告—–

——广告—–

一场震惊全国的校园枪击案,正在把人工智能监管问题推到加拿大政治议程的最前沿。

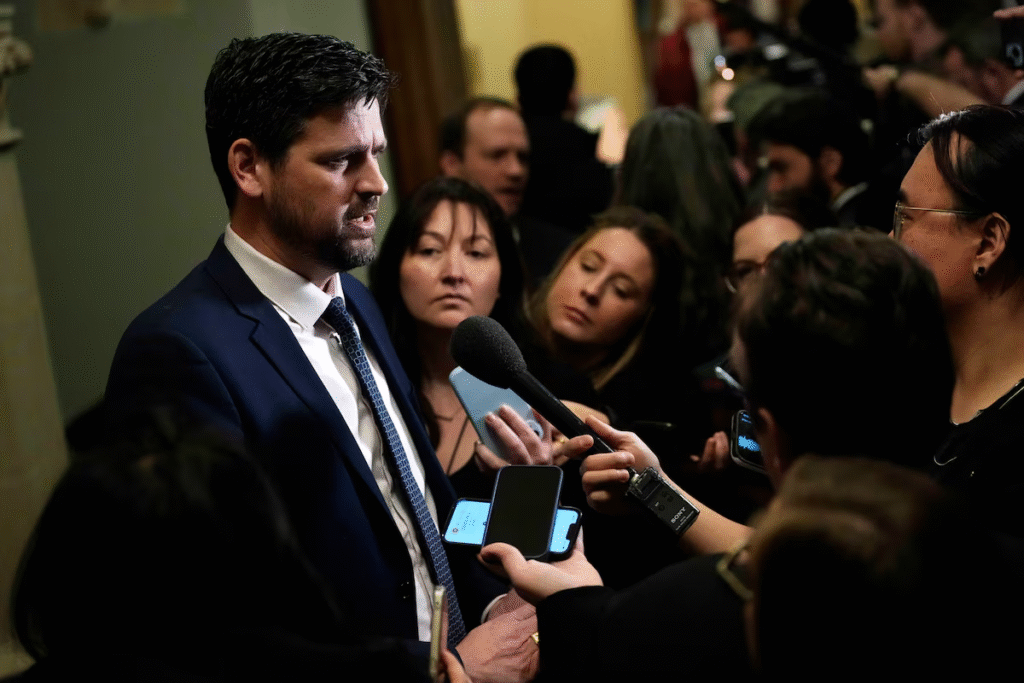

联邦司法部长 Sean Fraser 周三在渥太华明确警告:

如果 OpenAI 不迅速修改其内部报告机制,政府将考虑通过立法手段加强监管。

“我们已经明确传达:必须有改变。如果改变没有迅速到来,政府会采取行动。”

🔎 争议焦点:为何没有报警?

事件起因源于《华尔街日报》的报道。

报道称,在卑诗省 Tumbler Ridge 枪击案发生前,涉案者曾与 ChatGPT 进行多次涉及枪支暴力情景的对话。

OpenAI 内部员工曾希望向执法机构发出警告,但最终并未上报。

该案造成:

- 5名学生

- 1名教育工作者

- 枪手的母亲与同父异母兄弟

共多人遇害。

总理 Mark Carney 在探访当地后表示:

“任何能够阻止这场悲剧发生的措施,都必须被认真考虑。”

🧠 政府不满:为何没有“具体方案”?

人工智能部长 Evan Solomon 表示失望:

OpenAI 高管在与政府会面时,并未提出具体改进建议。

争议核心在于:

何种情况下,AI平台应将用户的暴力内容上报警方?

OpenAI采用的标准为:

“迫在眉睫且可信的严重身体伤害风险”

问题是——

这条标准是否被正确执行?外界并不知道。

🚨 是否会封禁 ChatGPT?

当被问及是否考虑在加拿大封禁 ChatGPT 时,所罗门回应:

“所有选项都在桌面上。”

不过随后其发言人澄清:

封禁并不是目前正在考虑的选项。

🏛️ 更多监管正在酝酿

- 身份与公民部长 Marc Miller 正在准备“网络伤害法案”

- 政府也在制定新的AI国家战略

- 参议院已启动关于AI安全与治理的听证会

公共安全部长 Gary Anandasangaree 表示:

“科技公司整体上做得不够。”

📚 专家观点:关键在透明度

渥太华大学互联网法律专家 Michael Geist 指出:

公众应当知道:

- 内容如何被监控

- 什么标准会触发报警

- 多久发生一次此类报告

问题并不仅仅是是否报警,而是规则是否清晰。

⚖️ 加拿大面临的难题

这场争议揭示出一个核心问题:

AI平台在保护隐私与预防暴力之间,应如何平衡?

- 报警门槛过低 → 侵犯隐私

- 报警门槛过高 → 可能错失预警

加拿大政府如今释放的信号很明确:

如果企业不主动加强安全机制,国家将通过法律介入。

🌍 更大的背景

随着AI工具渗透日常生活,政府监管压力正在全球范围上升。

加拿大正在试图回答一个关键问题:

当人工智能提前“看见危险”,它是否有义务发声?

这不仅是技术问题,更是伦理与法律的博弈。